哈尔滨工程大学国家特色化适应性软件学院软件中心师生的研究论文《Cross-modal and Cross-medium Adversarial Attack for Audio》日前被计算机多媒体领域顶级国际会议ACM International Conference on Multimedia接受并将在10月30日的会议论坛上进行宣讲。论文作者依次为张立国、田梓琳(博士生)、龙云飞(博士生)、李思照、印桂生。

ACM Multimedia是计算机多媒体领域首屈一指的国际会议,属于中国计算机学会推荐的A类国际学术会议。会议涵盖多个新兴领域,专注于推进多媒体的研究和应用。2023年第29届大会将汇聚工业界和学术界的新观点,介绍包括人工智能、多媒体检索、视觉和语言、人机交互和多媒体信号处理等多个计算机多媒体领域的最新成果。

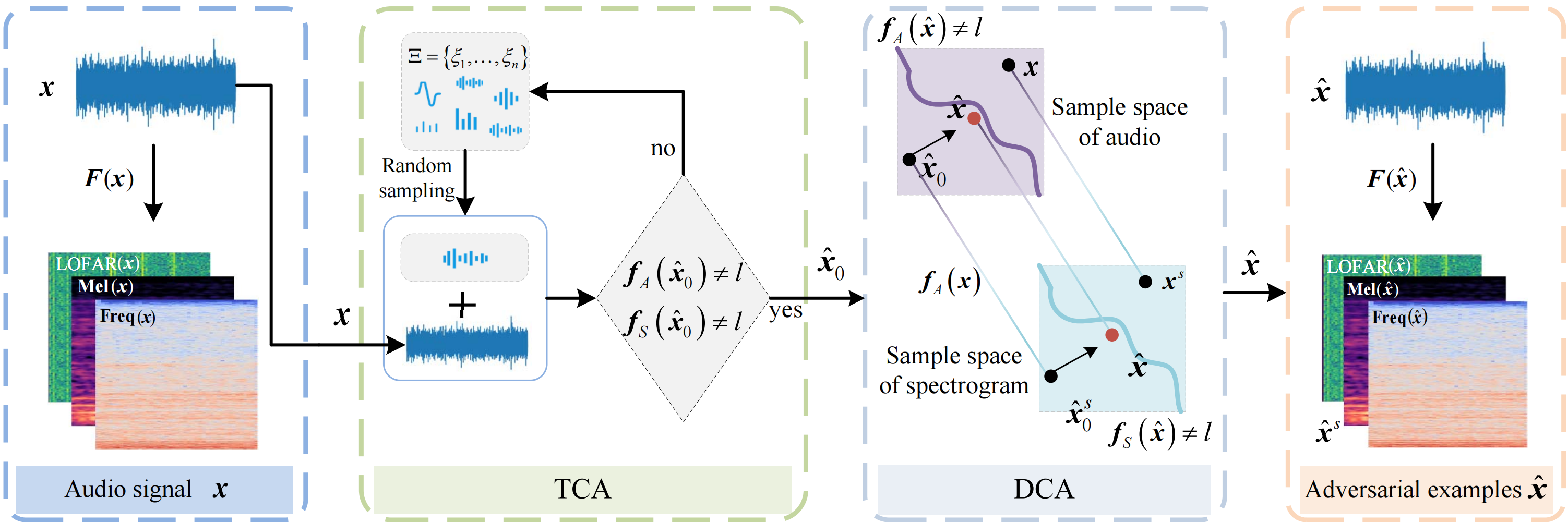

对抗攻击又称为智能欺骗,是一种针对人工智能技术的反问题研究。今年我院发表成果旨在研究多媒体领域的人工智能对抗攻击方法,聚焦于人工智能技术的安全问题。论文提出了一个细分研究方向—跨介质、跨模态的音频对抗攻击,即如何设计通过扰动同时欺骗音频识别模型和谱图识别模型,并保证其在空气和海水等传播介质中均有效。在该篇论文中,作者首次提出了跨介质攻击概念,并对跨模态攻击进行了定义,即单一来源的信号在经过不同介质和不同模态的传播和转换后,能够持续欺骗人工智能模型,极大提高了对抗攻击的泛化能力和鲁棒性。目前音频领域对抗攻击绝大部分都是在声波上进行,也有少量在谱图上进行,但并没有研究人员关注音频转化为谱图后是否依旧能欺骗目标模型。目前深度学习模型越来越复杂,在无法得知内部结构和参数的前提下,攻击者很难得知模型是以哪种处理模态对音频信号进行识别的,但目前可查的案例中并没有研究同时攻击以音频为输入的识别模型和以谱图为输入的识别模型。

可解释的跨模态对抗机理

论文实验结果表明,作者所设计的对抗扰动可使ResNet20/56等多个高精度识别模型性能严重下降,识别率从>90%降到<30%,并在船舶水噪声、鲸鱼歌声、人类语音、城市噪声和钢琴音乐等5个数据集上成功通过测试。

跨介质和跨模态概念为人工智能领域的对抗攻击提供了全新的思考角度和解决手段,这种新型攻击方式打破了传统的多媒体信号处理模式,使得声学信号攻击不再局限于单一模态或单一介质,而是能够跨越不同的模态和介质对人工智能模型进行欺骗。它不仅提高了攻击的复杂性和难度,也为防御者带来了更大的挑战,对于智能算法的安全测试提出了更高要求。该技术的应用前景除信息安全领域外、在军事国防技术上也有望为信息战提供装备伪装和隐身的新途径。据了解,该论文发表作者所属团队目前在可见光、红外、雷达波等信号格式上也在开展相关领域的对抗攻击技术研究,力争产出更多原创性高水平科技成果。